La cuenta atrás ya está en marcha. La Unión Europea ha puesto fecha al fin del periodo de adaptación de su Reglamento de Inteligencia Artificial y ha señalado el 2 de agosto de 2026 como el momento en el que gran parte de esta normativa estará plenamente en vigor. Desde entonces, las empresas que desarrollen o usen sistemas de alto riesgo deberán someterse a controles estrictos y asumir nuevas exigencias legales. En este contexto, cada vez cobra más importancia el debate sobre el impuesto a las empresas por uso de inteligencia artificial, una cuestión que también empieza a ganar peso en el ámbito económico y regulatorio.

Qué empresas deberán controlar sus sistemas de Inteligencia Artificial de alto riesgo

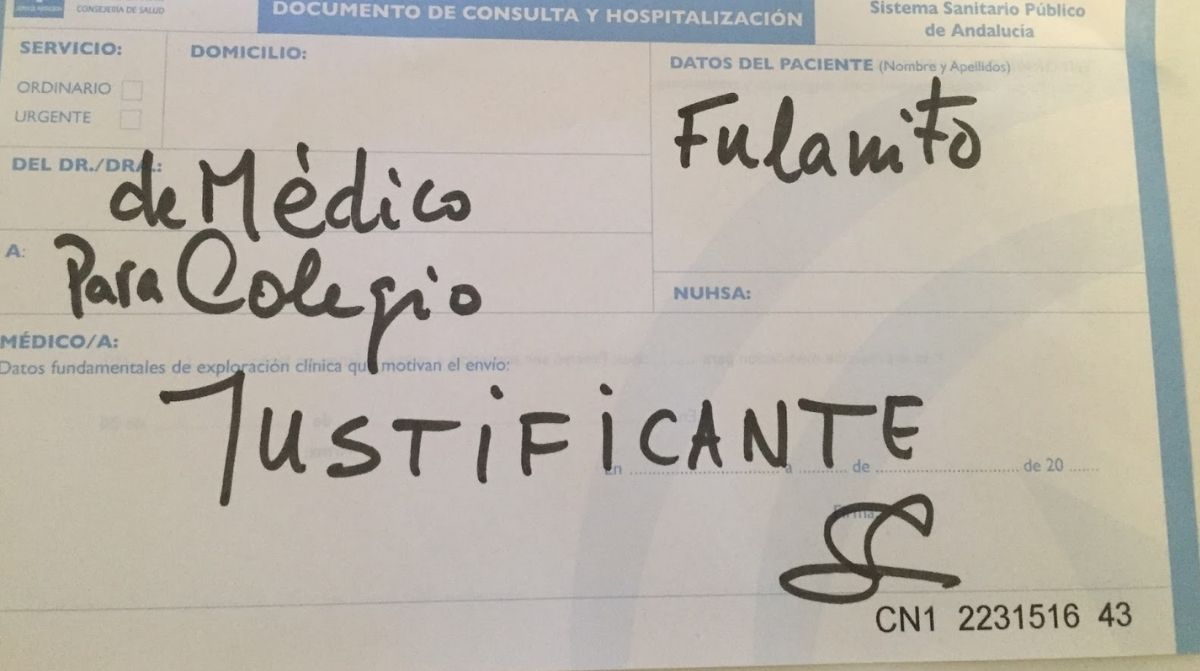

Tras las primeras fases, centradas en prohibir prácticas inaceptables, ahora llega el turno de los desarrolladores y usuarios de sistemas de alto riesgo. Hablamos de herramientas usadas en empleo, educación, justicia o infraestructuras críticas. ¿La clave? Ya no bastará con probar tecnología y esperar a ver qué pasa.

La norma obliga a implantar sistemas de gestión de calidad, documentación técnica y seguimiento posterior a la salida al mercado. Además, las empresas deberán garantizar supervisión humana competente y formada. Dicho de forma clara: toca ponerse las pilas.

Antes de seguir, estos son algunos de los principales controles que deberán asumir las compañías:

- Auditoría de algoritmos

- Gestión de riesgos

- Documentación técnica obligatoria

- Monitoreo post mercado

- Supervisión humana cualificada

Con estas medidas, Bruselas quiere avanzar hacia un mercado digital más seguro y reducir posibles sesgos y fallos en la IA.

Las multas millonarias que pueden cambiar la forma de operar de las empresas

El Reglamento (UE) 2024/1689 no pone el foco solo en los desarrolladores. También arrastra a toda la cadena de valor algorítmica, incluidas PYMES, integradores e importadores que distribuyan o implementen estas herramientas. Por tanto, el impacto será mucho más amplio de lo que parece a simple vista.

Para entender mejor el alcance, así queda resumido el nuevo escenario:

| Aspecto clave | Qué exige la norma |

|---|---|

| Fecha límite | 2 de agosto de 2026 |

| Sistemas afectados | IA de alto riesgo |

| Obligaciones | Gestión de calidad, transparencia, documentación y supervisión humana |

| Sanciones | Hasta 35 millones de euros o el 7% de la facturación mundial |

La advertencia es seria. La ignorancia técnica dejará de ser una excusa válida y las compañías deberán elevar sus estándares si quieren seguir operando.

El papel de la Oficina Europea de Inteligencia Artificial en la vigilancia

¿Quién vigilará que todo esto se cumpla? La Comisión Europea ya cuenta con la Oficina Europea de Inteligencia Artificial, un organismo que centralizará la supervisión de los modelos de propósito general, investigará posibles infracciones y podrá exigir medidas correctivas a los proveedores.

El objetivo de fondo es frenar el impacto social que una IA descontrolada puede tener sobre los derechos fundamentales de los europeos. En consecuencia, Bruselas busca cambiar por completo la forma de gestionar los riesgos tecnológicos y obligar a la dirección empresarial a responder ante la ley si sus sistemas fallan.

A medida que avanza la regulación europea, el uso de la inteligencia artificial empieza a convertirse también en una cuestión laboral y empresarial que puede transformar la forma de trabajar y gestionar equipos. La evolución de estos cambios la seguimos en nuestra sección de actualidad laboral, donde analizamos medidas económicas, transformaciones del mercado de trabajo y debates que afectan a empresas y trabajadores.